拾取器机器人 - 即拾取和放置物品的电动钳子 - 可能具有对它们有利的可重复性,但复杂的姿势和不熟悉的物体对它们中的大多数构成了挑战。难怪为什么:他们不仅需要定位物体并理解如何抓住它们,这需要大量的训练数据,但是他们必须将它们放下,以免它们受到损害或扰乱周围环境。

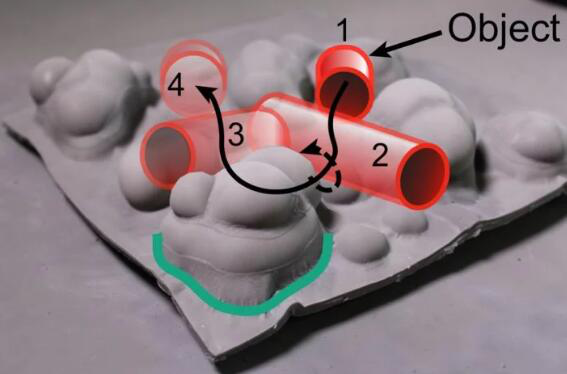

不过,请留给麻省理工学院计算机科学与人工智能实验室(CSAIL)的人们,开创一种克服这些障碍的方法。在一篇新发表的研究论文(“ K-PAM的类别级机器人操作:关键点负担操作 ”)中,他们描述了一个系统 - Keypoint Affordance Manipulation,或简称为“kPAM” - 检测一组目标坐标,称为关键点,启用机器人硬件,在其上部署处理一系列精巧的对象。

麻省理工学院教授兼资深作家拉斯泰德拉克在一份声明中说:“每当你在YouTube上看到一个机器人视频时,你应该仔细观察机器人没有 做什么。” “机器人几乎可以选择任何东西,但如果它是他们以前从未见过的物体,他们实际上无法以任何有意义的方式放下它。”

大多数拾取和放置感知和抓取算法估计位置,方向和几何形状而不是点,这很难转化为涉及形状奇特的物体的任务。相比之下,kPAM的三维关键点管道可以“自然地”适应对象类型之间的变化。Tedrake - 以及博士生Lucas Manuelli,Pete Florence和Wei Gao--说相对统一的目标只需要三个坐标,比如咖啡杯(重要的是,一个在底部中心和顶部中心),并且拖鞋,靴子和高跟鞋等物品足够六件。

“只需了解一下这个对象 - 一些关键点的位置 - 足以实现各种有用的操作任务,”Tedrake说。

研究人员利用“最先进的”积分AI模型进行关键点检测,该模型将单个RGB和深度图像作为输入,并输出每个坐标的概率热图和深度预测图。(在后续步骤中恢复2D图像坐标,深度值和最终3D关键点。)它们通过将关键点网格投影到图像空间中来收集来自包含感兴趣对象的场景的训练数据,给定来自3D重建算法的估计相机姿势。

在涉及安装有Schunk WSG 50夹持系统(和深度感应Primesense传感器)的Kuka IIWA LBR机器人的实验中,经过全面训练的系统成功引导机器人手臂将鞋子放在鞋架上,将马克杯直立放在架子上,并用手柄将杯子挂在架子上。

机器人在测试20件鞋子方面没有任何问题; 在100次试验中,只有两次未能将鞋子放在架子上。当抓手抓住鞋跟后,产生错误,导致其从原始位置移开。

在杯架任务中,包括40个不同形状,大小和视觉外观的杯子的测试装置,机器人设法在垂直躺着时抓住所有杯子,但由于夹子的行程有限而仅水平躺着。令人印象深刻的是,除了两次试验之外(当杯子倒置时),它将杯子放在距目标位置5厘米的架子上。

杯子手柄测试有一个较小的设置--30个杯子 - 和五个非常小的杯子,手柄的高度和宽度不到两厘米。夹具在100%的时间内将较大的杯子挂在架子上,但是对于较小的杯子,它只能达到50%的成功率。研究人员将失败案例归结为不准确的关键点检测。

其他领域也有改进的空间。Tedrake和共同作者指出,人类必须注释他们的系统所需的训练数据,他们打算通过用合成数据补充现实样本来逐步淘汰未来的工作。并且他们承认,即使对象类别没有改变,关键点也必须重新标记并且模型会重新训练。

尽管如此,他们认为它比大多数现有方法提供更大的灵活性,并且他们相信有一天,它可能有助于机器人承担诸如卸下洗碗机,擦拭厨房柜台以及在工厂和其他工业环境中执行拾取和放置工作等任务。 。