它们具有看似复杂的结果,但也有可能被愚弄,范围从相对无害-将动物误识别为另一动物-到引导自动驾驶汽车的网络将停车标志误解为指示停车标志的潜在危险是可以安全进行的。

休斯顿大学的一位哲学家在发表于《自然机器智能》上的一篇论文中暗示,关于这些假定故障背后原因的普遍假设可能是错误的,这些信息对于评估这些网络的可靠性至关重要。

随着机器学习和其他形式的人工智能越来越深入地融入社会,从自动柜员机到网络安全系统,其用途广泛,UH哲学副教授卡梅伦·巴克纳(Cameron Buckner)表示,了解由什么导致的明显故障的来源至关重要。

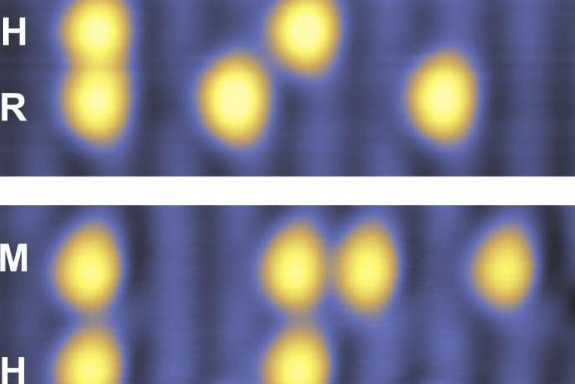

研究人员称其为“对抗性例子”,是指当深度神经网络系统遇到用于构建网络的训练输入之外的信息时,会误判图像或其他数据。它们很罕见,被称为“对抗性”,因为它们通常是由另一个机器学习网络创建或发现的-机器学习领域中的一种边缘技术,介于创建复杂示例的更复杂方法与检测和避免它们的更复杂方法之间。

巴克纳说:“这些对抗性事件中的一些反而可能是人工产物,为了更好地了解这些网络的可靠性,我们需要更好地了解它们是什么。”

换句话说,不发火可能是由网络需要处理的内容和所涉及的实际模式之间的相互作用引起的。这与完全被误解不是完全一样的。

巴克纳写道:“理解对抗性例子的含义需要探索第三种可能性:至少其中一些模式是人工制品。”“……因此,目前简单地丢弃这些模式既有代价,也有天真地使用它们的危险。”

导致这些机器学习系统犯错误的对抗事件不一定是故意的渎职造成的,但这是最高的风险所在。

巴克纳说:“这意味着恶意行为者可能欺骗依赖于本来可靠的网络的系统。”“那有安全应用程序。”