еЊИе§ЪжЬЛеПЛдЄНзЯ•йБУгАРиЛєжЮЬAIеЫЊеГПе§ДзРЖжЦ∞з™Бз†іпЉЪдЄАзІТ2Dиљђ3D ињШеПѓиѓДдїЈPеЫЊжХИжЮЬгАСпЉМдїК姩е∞Пзїње∞±дЄЇе§ІеЃґиІ£з≠ФдЄАдЄЛгАВ

иЛєжЮЬеЬ®2025еєі12жЬИеПСеЄГдЇЖдЄАй°єеРНдЄЇгАКSharp Monocular View Synthesis in Less Than a SecondгАЛзЪДз†Фз©ґпЉМиѓ¶зїЖдїЛзїНдЇЖдЄАдЄ™еРНдЄЇSHARPзЪДеЉАжЇРAIж®°еЮЛпЉМдЄФеЈ≤еЕђеЉАеЬ®GitHubдЄКгАВиѓ•ж®°еЮЛиГље§ЯеЬ®дЄНеИ∞дЄАзІТзЪДжЧґйЧіеЖЕпЉМе∞ЖеНХеЉ†2DеЫЊеГПиљђжНҐдЄЇ3DеЬЇжЩѓгАВ

з†Фз©ґдљњзФ®дЇЖжґµзЫЦ20дЄ™еЖЕеЃєз±їеИЂзЪДдЄКеНГдЄ™зЉЦиЊСз§ЇдЊЛпЉМжµЛиѓХдЇЖеМЕжЛђMGIEгАБOmniGenеТМGPT-Image 1еЬ®еЖЕзЪДе§ЪдЄ™ж®°еЮЛгАВз†Фз©ґеПСзО∞пЉМOpenAIзЪДGPT-Image-1ж®°еЮЛзїЉеРИи°®зО∞жЬАдљ≥гАВз†Фз©ґжМЗеЗЇпЉМиЩљзДґGPT-Image-1еЬ®жЙІи°Мж†ЄењГзЉЦиЊСжЦєйЭҐиГљеКЫеЊИеЉЇпЉМдљЖеЬ®з©ЇйЧіеЕ≥з≥їзЪДзїЖз≤ТеЇ¶жОІеИґеТМеЖЕеЃєдњЭзЬЯеЇ¶дЄКдїНжЬЙжПРеНЗз©ЇйЧігАВ

иЛєжЮЬзЪДеП¶дЄАй°єз†Фз©ґеЕ≥ж≥®AIж®°еЮЛеѓєдЄНеРМиѓ≠и®АпЉМзЙєеИЂж؃嚥жАБдЄ∞еѓМиѓ≠и®АзЪДзРЖиІ£иГљеКЫгАВз†Фз©ґдЇЇеСШжМЗеЗЇпЉМAIж®°еЮЛйАЪеЄЄйЪЊдї•е§ДзРЖињЩз±їиѓ≠и®АпЉМдЄФвАЬињЩдЇЫж®°еЮЛеЬ®е§Ъе§Із®ЛеЇ¶дЄКзЬЯж≠£жОМжП°дЇЖињЩдЇЫиѓ≠и®АзЪДеЇХе±Виѓ≠и®Ае§НжЭВжАІдїНдЄНжЄЕж•ЪвАЭгАВ

дЄЙгАБIMPACTпЉЪиѓДдЉ∞AIеѓєе§Ъиѓ≠и®А嚥жАБе§НжЭВжАІзЪДзРЖиІ£

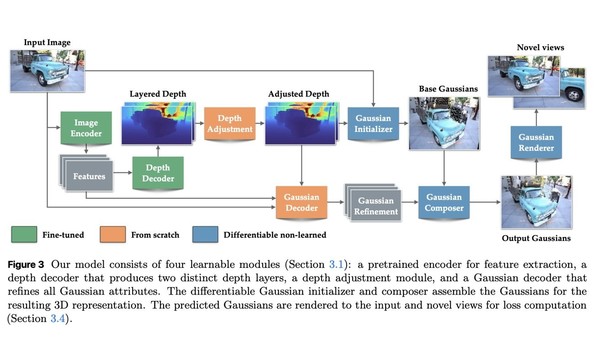

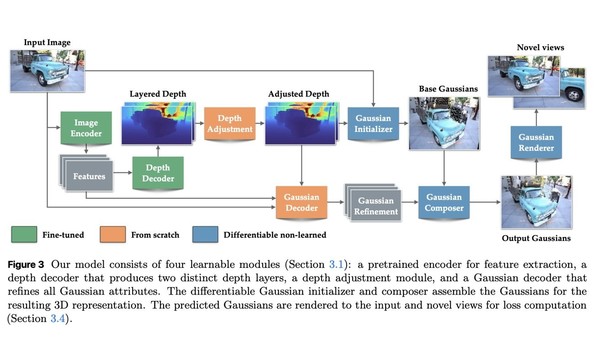

з†Фз©ґдЇЇеСШеЬ®е§ІеЮЛжХ∞жНЃйЫЖдЄКиЃ≠зїГSHARPпЉМдљњеЕґиГље§ЯйҐДжµЛ3DеЬЇжЩѓзЪДжЈ±еЇ¶еєґзФЯжИРзЫЄеЇФзЪДйЂШжЦѓи°®з§ЇгАВеЬ®е§ЪжХ∞жГЕеЖµдЄЛпЉМж®°еЮЛи°®зО∞жИРеКЯпЉМдљЖдєЯе≠ШеЬ®дЄАдЇЫ姱賕ж°ИдЊЛпЉМдЊЛе¶ВзЙ©дљУ襀жЄ≤жЯУеЬ®йФЩиѓѓдљНзљЃпЉИе¶ВиЬЬиЬВ襀жФЊеЬ®иК±жЬµеРОйЭҐиАМйЭЮдЄКйЭҐпЉЙпЉМжИЦе∞Ж姩穯胃еИ§дЄЇйЩДињСзЪДжЫ≤йЭҐгАВз†Фз©ґиѓДдЉ∞дЇЖ8дЄ™е§Ъиѓ≠и®Ае§Іиѓ≠и®Аж®°еЮЛгАВжµЛиѓХеИЖдЄЇдЄ§зІНеЬЇжЩѓпЉЪдЄАжШѓиЃ©ж®°еЮЛйҐДжµЛж≠£з°ЃзЪДиѓН嚥еПШеМЦпЉИзФЯжИРдїїеК°пЉЙпЉМдЇМжШѓиЃ©ж®°еЮЛеИ§жЦ≠зїЩеЃЪиѓ≠еП•жШѓеР¶иѓ≠ж≥Хж≠£з°ЃпЉИеИ§жЦ≠дїїеК°пЉЙгАВж®°еЮЛйЬАи¶БеЃМжИРе°Ђз©ЇжµЛиѓХпЉМеєґжЙЃжЉФвАЬж≥ХеЃШвАЭиІТиЙ≤гАВдЄЇж≠§пЉМиЛєжЮЬеЉАеПСдЇЖIMPACTж°ЖжЮґпЉМдЄУйЧ®иѓДдЉ∞е§Іиѓ≠и®Аж®°еЮЛеЬ®йШњжЛЙдЉѓиѓ≠гАБдњДиѓ≠гАБиКђеЕ∞иѓ≠гАБеЬЯиА≥еЕґиѓ≠еТМеЄМдЉѓжЭ•иѓ≠дЄ≠пЉМиЊУеЗЇжШѓеР¶зђ¶еРИеЕґе±ИжКШ嚥жАБе≠¶иІДеИЩзЪДиГљеКЫгАВе±ИжКШ嚥жАБе≠¶жґЙеПКйАЪињЗиѓНзЉАжФєеПШеНХиѓНдї•йАВеЇФзЙєеЃЪиѓ≠ж≥ХзїУжЮДпЉИе¶ВеРНиѓНзЪДжХ∞гАБеК®иѓНзЪДжЧґжАБпЉЙгАВиЛєжЮЬзЪДз†Фз©ґдЇЇеСШињШиЃЊиЃ°дЇЖдЄАдЄ™зФ®дЇОиѓДдЉ∞жЦЗжЬђеЉХеѓЉеЫЊеГПзЉЦиЊСAIж®°еЮЛзЪДж°ЖжЮґгАВиѓ•ж°ЖжЮґдїОдЄ§дЄ™ж†ЄењГзїіеЇ¶еѓєж®°еЮЛиЊУеЗЇињЫи°МиѓДеИЖпЉЪдЄАгАБSHARPж®°еЮЛпЉЪдЄАзІТеЖЕдїО2DеЫЊеГПзФЯжИР3DеЬЇжЩѓSHARP襀жППињ∞дЄЇвАЬдїОеНХеЉ†еЫЊеГПињЫи°МйАЉзЬЯиІЖеЫЊеРИжИРзЪДжЦєж≥ХвАЭгАВзїЩеЃЪдЄАеЉ†еЫЊеГПпЉМеЃГдЉЪвАЬеЫЮељТеЗЇжЙАжППзїШеЬЇжЩѓзЪД3DйЂШжЦѓи°®з§ЇеПВжХ∞вАЭгАВдЄОдљњзФ®дЄЙиІТ嚥谮积3DеЬЇжЩѓзЪДдЉ†зїЯжЦєж≥ХдЄНеРМпЉМйЂШжЦѓи°®з§ЇйАЪињЗжХ∞зЩЊдЄЗдЄ™ж§≠зРГдљУжИЦвАЬжЦСзВєвАЭжЭ•жЄ≤жЯУдљУзІѓпЉМеЕ±еРМжЮДжИР3DеЫЊеГПгАВйАЪеЄЄпЉМеИЫеїЇж≠§з±ї3Dи°®з§ЇйЬАи¶БдїОдЄНеРМиІТеЇ¶жЛНжСДеРМдЄАзЙ©дљУзЪДе§ЪеЉ†зЕІзЙЗпЉМдљЖSHARPдїЕйЬАеНХеЉ†еЫЊеГПпЉМеєґйАЪињЗз•ЮзїПзљСзїЬзЪДдЄАжђ°еЙНеРСдЉ†жТ≠еН≥еПѓеЃМжИРгАВ

иЛєжЮЬAI

дЇМгАБGIE-BenchпЉЪжЦЗжЬђеЉХеѓЉеЫЊеГПзЉЦиЊСзЪДиѓДдЉ∞ж°ЖжЮґгАРCNMOзІСжКАжґИжБѓгАСињСжЬЯпЉМиЛєжЮЬеЬ®дЇЇеЈ•жЩЇиГљпЉИAIпЉЙй©±еК®зЪДеЫЊеГПе§ДзРЖйҐЖеЯЯеПСеЄГе§Ъй°єйЗНи¶Бз†Фз©ґжИРжЮЬгАВжНЃCNMOдЇЖиІ£пЉМињЩдЇЫжИРеКЯжґµзЫЦдїОеНХеЉ†еЫЊеГПењЂйАЯзФЯжИР3DеЬЇжЩѓгАБжЦЗжЬђеЉХеѓЉеЫЊеГПзЉЦиЊСзЪДиѓДдЉ∞пЉМеИ∞еѓєе§Ъиѓ≠и®Ае§НжЭВ嚥жАБзЪДзРЖиІ£жµЛиѓДгАВеЫЊеГПдњЭзЬЯеЇ¶пЉЪйЗЗзФ®еѓєи±°жДЯзЯ•зЪДжО©з†БжКАжЬѓеТМдњЭзЬЯеЇ¶иѓДеИЖпЉМз°ЃдњЭеЫЊеГПдЄ≠йЭЮзЫЃж†ЗеМЇеЯЯдЄН襀жДПе§ЦжЫіжФєгАВдїОдї•дЄКжИРжЮЬжЭ•зЬЛпЉМиЩљзДґиЛєжЮЬAIеЫҐйШЯињСжЬЯжЬЙжЙАеПШеК®пЉМдљЖеЕђеПЄеЬ®дЇЇеЈ•жЩЇиГљз†Фз©ґдЄКзЪДж≠•дЉРеєґжЬ™жФЊзЉУгАВдїОењЂйАЯ3DйЗНеїЇгАБеЫЊеГПзЉЦиЊСиѓДдЉ∞еИ∞е§Ъиѓ≠и®АзРЖиІ£жµЛиѓДпЉМињЩдЇЫз†Фз©ґдЄНдїЕжО®еК®дЇЖжКАжЬѓињЫж≠•пЉМдєЯдЄЇиЛєжЮЬиЗ™иЇЂдЇІеУБпЉИе¶ВApple IntelligenceгАБImage PlaygroundеЫЊеГПзФЯжИРеЈ•еЕЈеПКеЃЮжЧґзњїиѓСеКЯиГљпЉЙзЪДињ≠дї£дЉШеМЦжПРдЊЫдЇЖеЭЪеЃЮеЯЇз°АгАВеЄВеЬЇдєЯжЬЯеЊЕеЕґзїУеРИдЄКдЄЛжЦЗжДЯзЯ•зЪДSiriзЙИжЬђйЪПжЬ™жЭ•з≥їзїЯжЫіжЦ∞иАМжО®еЗЇгАВзїУжЮЬи°®жШОпЉМе§Іе§ЪжХ∞AIж®°еЮЛйГљйЪЊдї•е§ДзРЖдЄНеЄЄиІБзЪД嚥жАБж®°еЉПпЉМе∞§еЕґжШѓеЬ®еИ§жЦ≠дЄНеРИиѓ≠ж≥ХзЪДдЊЛеП•жЧґгАВе∞љзЃ°жЯРдЇЫж®°еЮЛеЬ®жЯРдЄАзІНиѓ≠и®АдЄКи°®зО∞зЫЄеѓєиЊГе•љпЉМдљЖеЬ®жЙАжЬЙжµЛиѓХиѓ≠и®АдЄ≠зЪДи°®зО∞еЭЗйАКдЇОеЕґеЬ®иЛ±иѓ≠дЄКзЪДи°®зО∞гАВињЩй°єз†Фз©ґдЄЇиЛєжЮЬиѓДдЉ∞еЕґеЖЕйГ®ж®°еЮЛпЉИе¶ВзФ®дЇОеЃЮжЧґзњїиѓСзЪДж®°еЮЛпЉЙеЬ®е§ДзРЖ嚥жАБе§НжЭВиѓ≠и®АжЧґзЪДжАІиГљжПРдЊЫдЇЖеЈ•еЕЈгАВеКЯиГљж≠£з°ЃжАІпЉЪйАЪињЗиЗ™еК®зФЯжИРзЪДе§ЪйАЙйҐШжЭ•й™МиѓБиѓЈж±ВзЪДзЉЦиЊСжШѓеж襀жИРеКЯжЙІи°МгАВзЙИжЭГжЙАжЬЙпЉМжЬ™зїПиЃЄеПѓдЄНеЊЧиљђиљљ

дї•дЄКйЧЃйҐШеЈ≤зїПеЫЮз≠ФдЇЖгАВе¶ВжЮЬдљ†жГ≥дЇЖиІ£жЫіе§ЪпЉМиѓЈеЕ≥

жЦ∞зїПзљСзљСзЂЩ (

https://www.xinhuatone.com/)

йГСйЗНе£∞жШОпЉЪжЬђжЦЗзЙИжЭГељТеОЯдљЬиАЕжЙАжЬЙпЉМиљђиљљжЦЗзЂ†дїЕдЄЇдЉ†жТ≠жЫіе§Ъдњ°жБѓдєЛзЫЃзЪДпЉМе¶ВдљЬиАЕдњ°жБѓж†ЗиЃ∞жЬЙиѓѓпЉМиѓЈзђђдЄАжЧґйЧіиБФз≥їжИСдїђдњЃжФєжИЦеИ†йЩ§пЉМе§Ъи∞ҐгАВ